Tehokas PDF-tekstin poiminta Vision Language -mallien avulla —— Miksi olmOCR muuttaa pelin

OLMOCR Team

3. maaliskuuta 2025

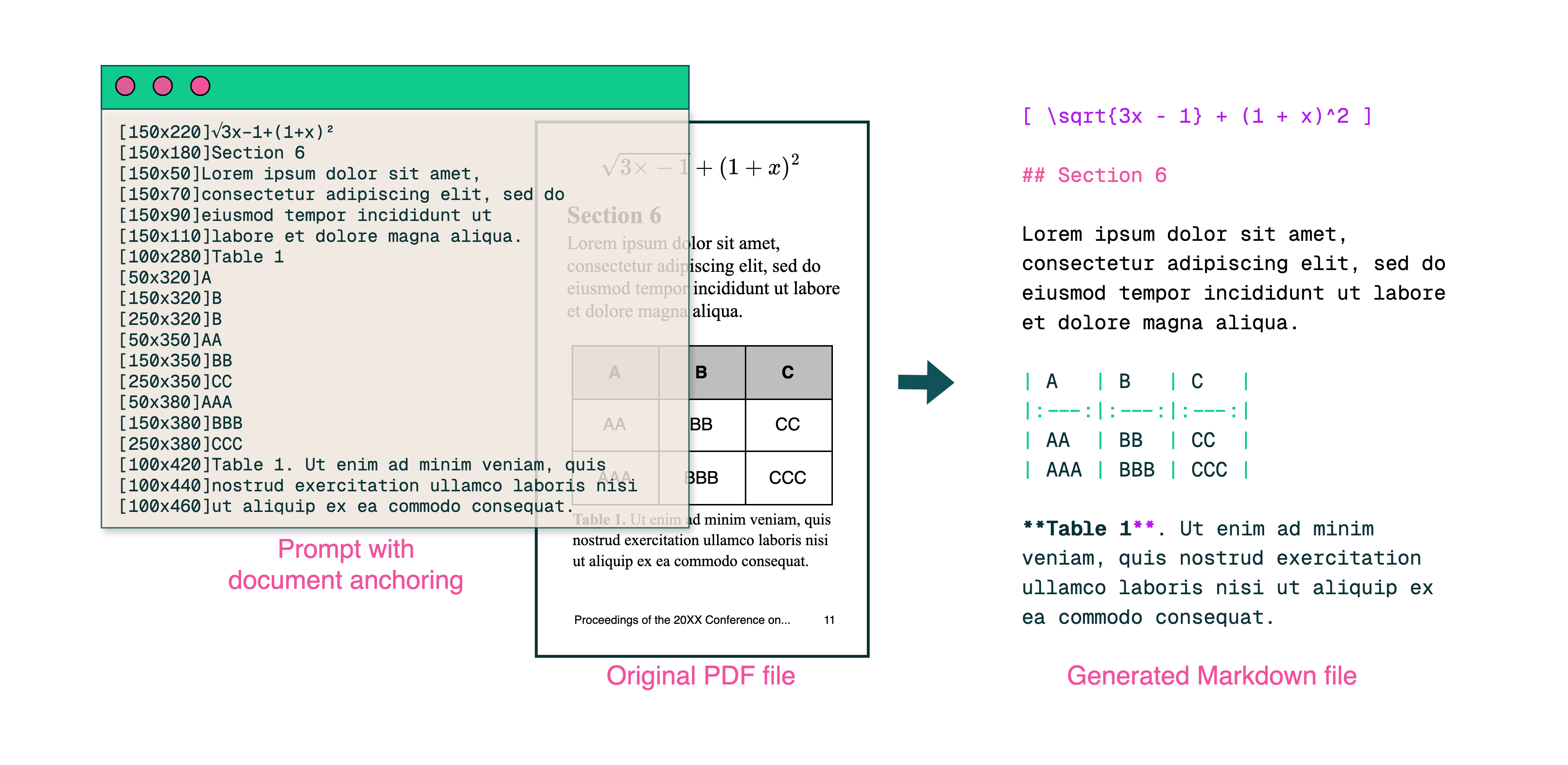

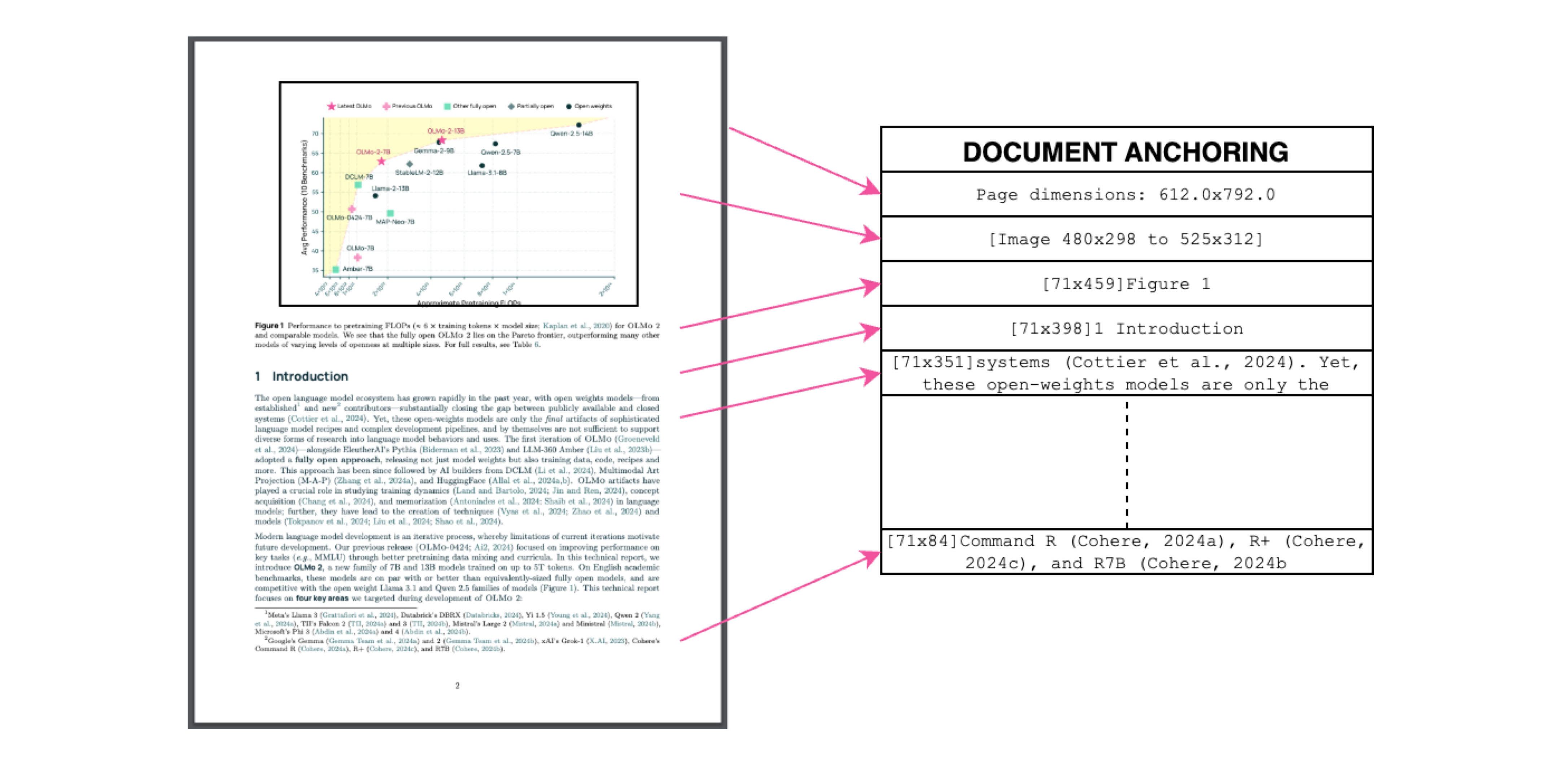

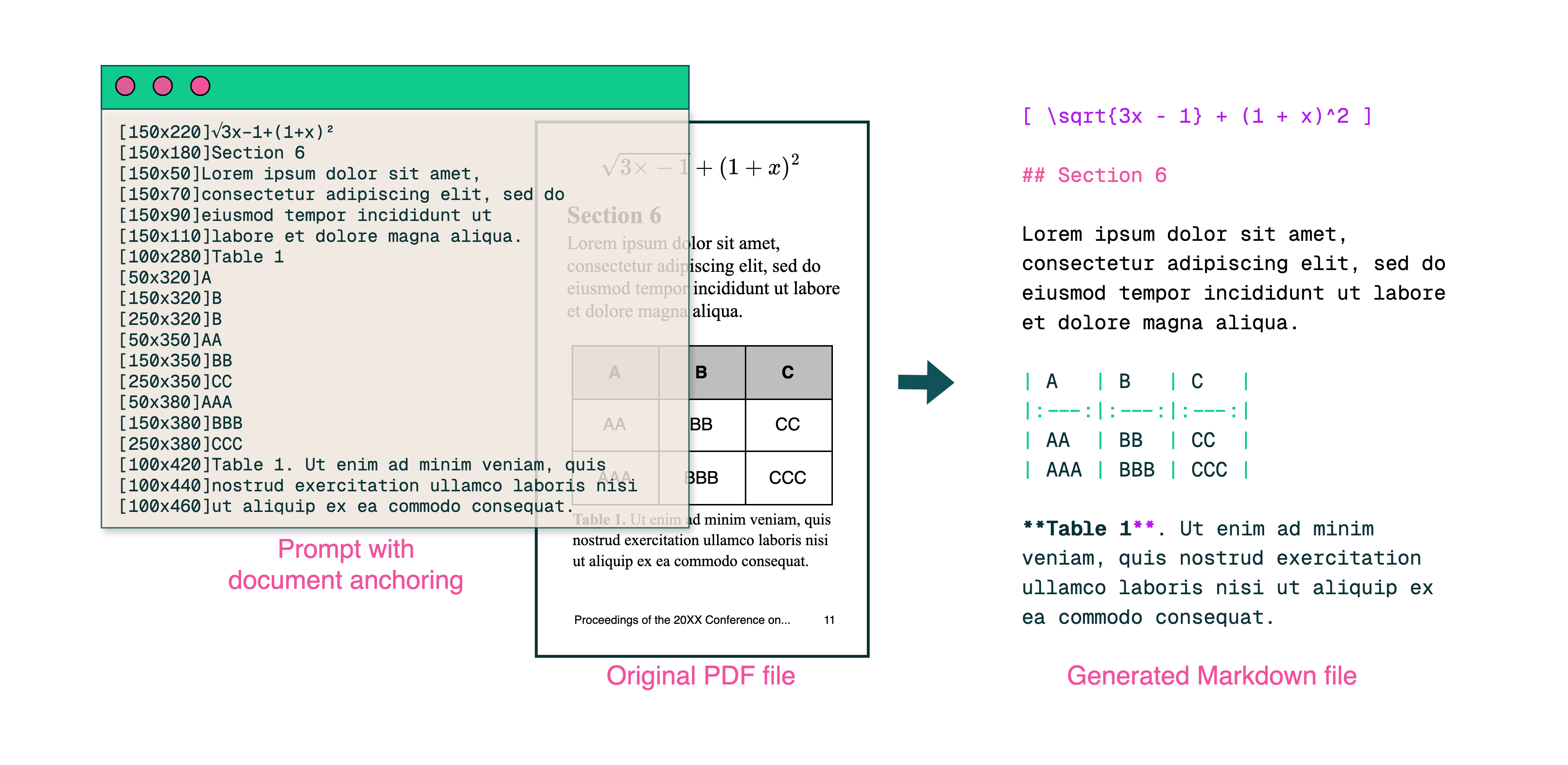

Kuvateksti: olmOCR:n päästä päähän -putki muuntaa sotkuiset PDF-tiedostot jäsennellyksi Markdown-tekstiksi 1/32 GPT-4o:n kustannuksella.

Kuvateksti: olmOCR:n päästä päähän -putki muuntaa sotkuiset PDF-tiedostot jäsennellyksi Markdown-tekstiksi 1/32 GPT-4o:n kustannuksella.

PDF-tiedostojen piilotettu haaste: Miksi pelkkä teksti on tärkeää

Kielimallit viihtyvät puhtaalla tekstillä – mutta PDF-tiedostot ovat äärimmäinen vihollinen. Ne on suunniteltu tulostamista varten, ei jäsentämistä, ne sekoittavat tekstin sijainteja, hautaavat taulukoita binäärikoodiin ja muuttavat yhtälöt visuaalisiksi arvoituksiksi. Perinteiset OCR-työkalut? Ne jättävät usein huomiotta muotoilun, kamppailevat monisarakkeisten asettelujen kanssa tai veloittavat omaisuuden.

Esittelyssä olmOCR: avoimen lähdekoodin työkalupakki, joka yhdistää vision language -mallit (VLM) ja älykkään suunnittelun PDF-koodin murtamiseksi. Puretaanpa, miksi kehittäjät ja tutkijat ovat innoissaan siitä.

5 syytä, miksi olmOCR loistaa muita työkaluja paremmin

-

Kustannustehokkuus, jota on vaikea sivuuttaa

Käsittele 1 miljoona sivua 190 dollarilla – se on 32x halvempaa kuin GPT-4o:n erä-API:t. Miten? Hienosäätämällä 250 000 monipuolisella sivulla (akateemiset artikkelit, oikeudelliset asiakirjat, jopa käsin kirjoitetut kirjeet) ja optimoimalla päättelyn SGLang/vLLM:llä.

Käsittele 1 miljoona sivua 190 dollarilla – se on 32x halvempaa kuin GPT-4o:n erä-API:t. Miten? Hienosäätämällä 250 000 monipuolisella sivulla (akateemiset artikkelit, oikeudelliset asiakirjat, jopa käsin kirjoitetut kirjeet) ja optimoimalla päättelyn SGLang/vLLM:llä. -

Markdown-taikaa Ei enää regex-painajaisia. olmOCR tuottaa puhdasta Markdownia:

- Säilyttää yhtälöt (

E=mc²) - Taulukot, jotka pysyvät taulukoina

- Oikea lukujärjestys monimutkaisille asetteluille

- Säilyttää yhtälöt (

-

Akut mukana -putki

python -m olmocr.pipeline ./workspace --pdfs your_file.pdfSkaalaa saumattomasti 1:stä yli 100 GPU:hun. Sisäänrakennettu virheiden käsittely ratkaisee yleisiä PDF-ongelmia, kuten metatietojen vioittumisen.

-

Avoimen lähdekoodin, ei mustia laatikoita Painot, koulutusdata (kyllä, kaikki 250 000 sivua!) ja koodi ovat julkisia. Rakennettu Qwen2-VL-7B-Instruct - ei omistusoikeudellisia riippuvuuksia.

-

Ihmisen todistettu paremmuus

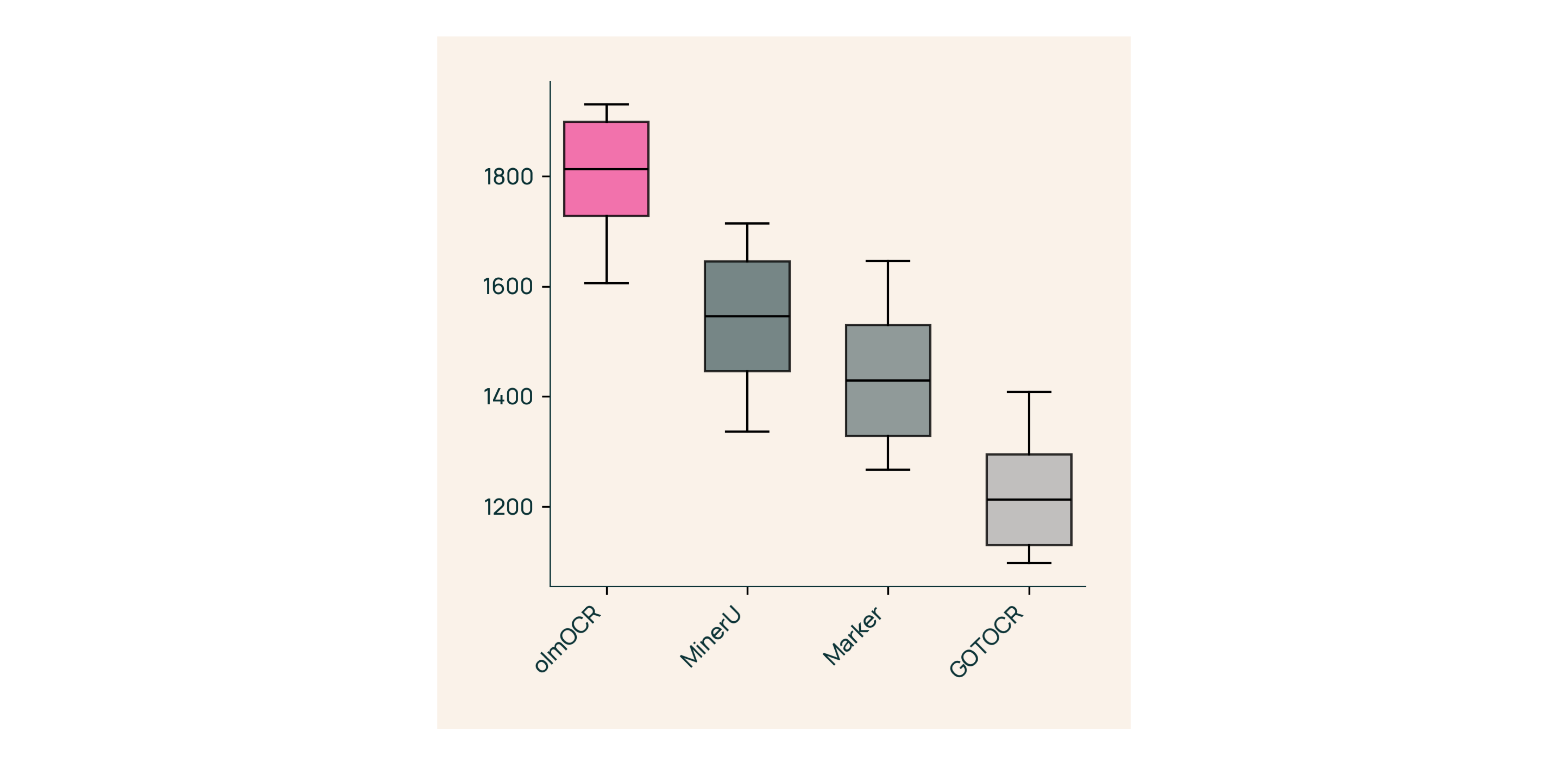

Sokeissa testeissä Markeria, GOT-OCR 2.0:aa ja MinerU:ta vastaan:

Sokeissa testeissä Markeria, GOT-OCR 2.0:aa ja MinerU:ta vastaan:- Voittaa 61 % vertailuista

- Saavuttaa ELO >1800 (kultainen standardi)

Konepellin alla: Miten rakensimme olmOCR:n

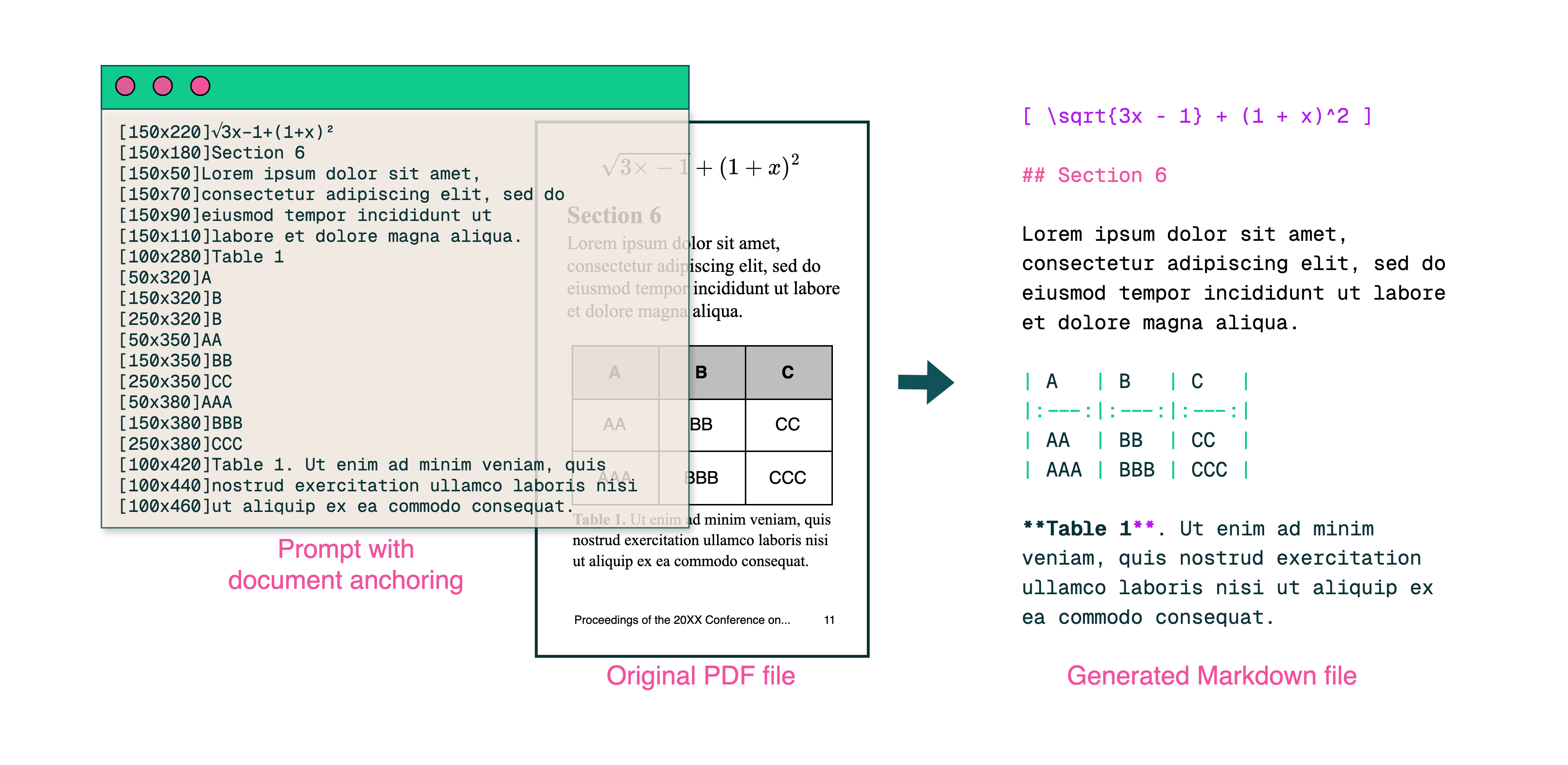

Asiakirjan ankkurointi: Salainen ainesosa

Kuvateksti: Teksti + kuvan konteksti = tarkka poiminta.

Kuvateksti: Teksti + kuvan konteksti = tarkka poiminta.

Käytämme PDF-tiedostojen omaa tekstiä/metatietoja "ankkuroimaan" VLM:t koulutuksen aikana:

- Poimi tekstilohkot ja kuvat

- Yhdistä ne mallikehotteisiin

- Anna GPT-4o:n luoda "kultaisen standardin" tunnisteet

Tulos? Malli, joka ymmärtää sekä mitä teksti sanoo että missä se kuuluu.

Koulutus todelliseen maailmaan

- Tietojoukko: 60 % akateemisia artikkeleita, 12 % esitteitä, 11 % oikeudellisia asiakirjoja

- Laitteisto: Optimoitu NVIDIA GPU:ille, 90 % pienempi energiankulutus kuin vastaavissa asetuksissa

- Hienosäätö: Qwen2-VL-7B-Instruct mukautettu asiakirjan "keskusteluille"

Kokeile olmOCR:ää 3 minuutissa

- Asenna

git clone https://github.com/allenai/olmocr && cd olmocr pip install -e . - Suorita näyte-PDF:llä

python -m olmocr.pipeline ./demo_output --pdfs tests/gnarly_pdfs/horribleocr.pdf - Tarkista Markdown

Avaa

./demo_output/horribleocr.md– näe taulukot, yhtälöt ja tekstin virtaus ehjinä!

Lopullinen johtopäätös

olmOCR ei ole vain yksi työkalu lisää – se on paradigman muutos. Yhdistämällä VLM:t läpinäkyvään suunnitteluun se tekee korkealaatuisen tekstinpoiminnan kaikkien saataville. Olitpa sitten rakentamassa tutkimusaineistoa tai automatisoimassa laskujen käsittelyä, tämä työkalupakki kuuluu pinossasi.

Seuraavat vaiheet

- ⭐ Tähtää GitHub-repo

- 📊 Vertaa tuloksia Interaktiivisen työkalun avulla

- 💬 Liity keskusteluun Hugging Face -sivustolla

Muutetaan PDF-tuska pelkäksi tekstiksi! 🚀