Extraction de texte PDF efficace avec les modèles de langage visuel —— pourquoi olmOCR change la donne

OLMOCR Team

3 mars 2025

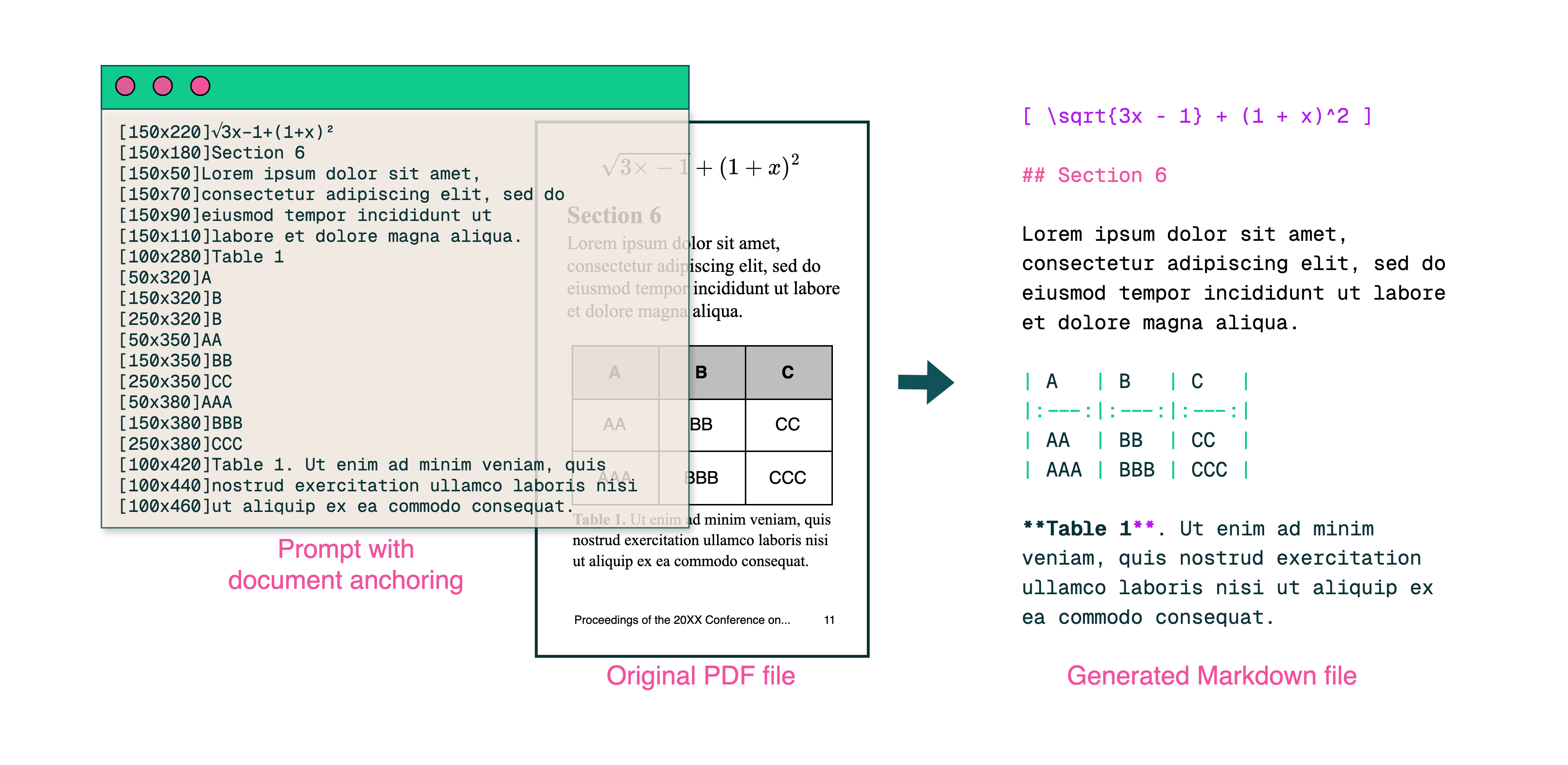

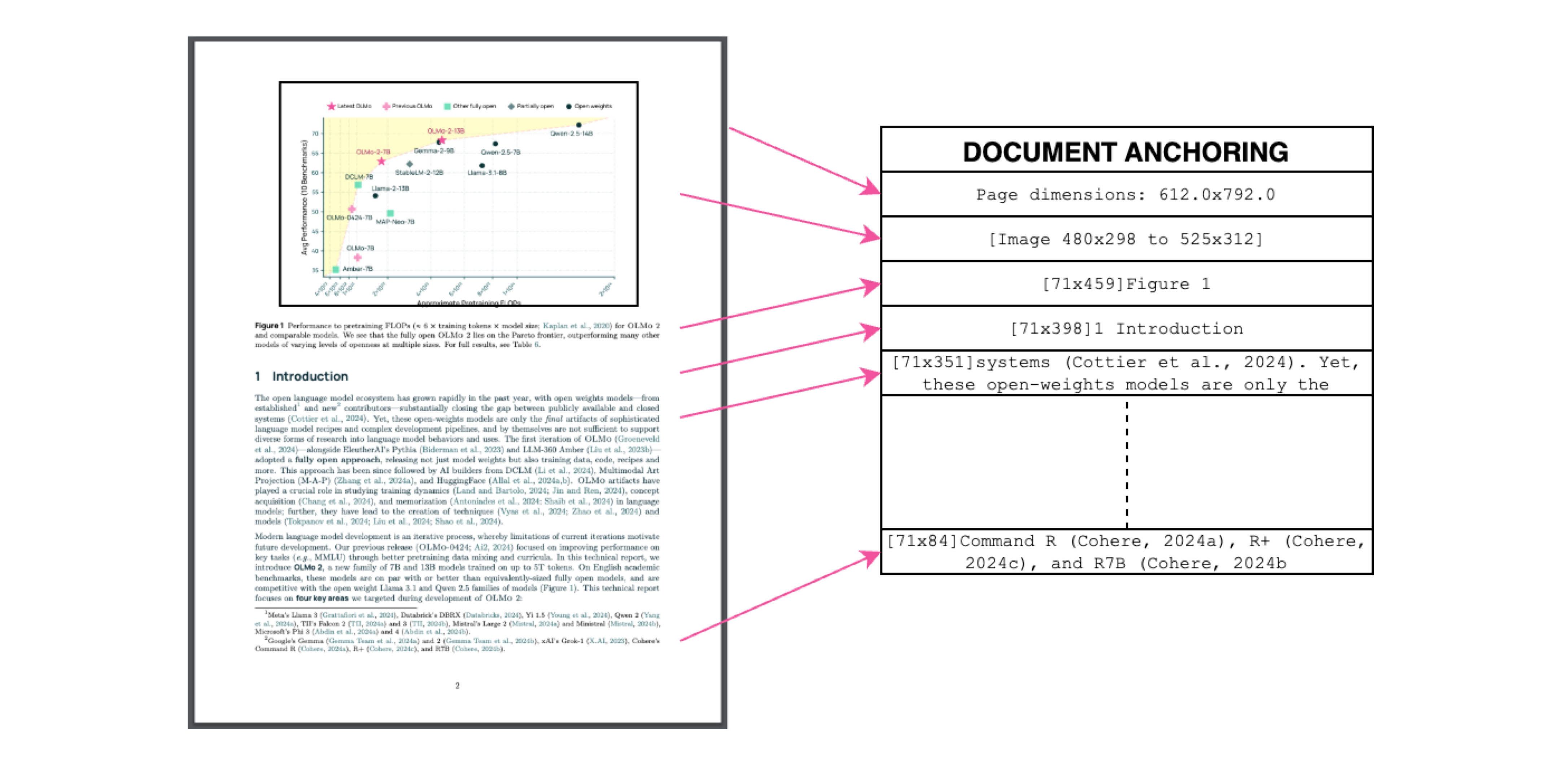

Légende : Le pipeline de bout en bout d'olmOCR convertit les PDF complexes en texte Markdown structuré à un coût 32 fois inférieur à celui de GPT-4o.

Légende : Le pipeline de bout en bout d'olmOCR convertit les PDF complexes en texte Markdown structuré à un coût 32 fois inférieur à celui de GPT-4o.

Le défi caché des PDF : pourquoi le texte brut est important

Les modèles de langage prospèrent grâce à un texte propre, mais les PDF sont l'ennemi juré ultime. Conçus pour l'impression, et non pour l'analyse, ils mélangent les positions du texte, enfouissent les tableaux dans du code binaire et transforment les équations en énigmes visuelles. Les outils OCR traditionnels ? Ils manquent souvent de formatage, ont du mal avec les mises en page à plusieurs colonnes ou coûtent une fortune.

Voici olmOCR : une boîte à outils open-source qui combine des modèles de langage visuel (VLM) avec une ingénierie intelligente pour décrypter le code PDF. Décomposons pourquoi les développeurs et les chercheurs en parlent tant.

5 raisons pour lesquelles olmOCR surpasse les autres outils

-

Une rentabilité difficile à ignorer

Traitez 1 million de pages pour 190 $ - c'est 32 fois moins cher que les API par lots de GPT-4o. Comment ? En effectuant un réglage fin sur 250 000 pages diverses (articles universitaires, documents juridiques, voire des lettres manuscrites) et en optimisant l'inférence avec SGLang/vLLM.

Traitez 1 million de pages pour 190 $ - c'est 32 fois moins cher que les API par lots de GPT-4o. Comment ? En effectuant un réglage fin sur 250 000 pages diverses (articles universitaires, documents juridiques, voire des lettres manuscrites) et en optimisant l'inférence avec SGLang/vLLM. -

La magie du Markdown Fini les cauchemars de regex. olmOCR produit du Markdown propre avec :

- Des équations conservées (

E=mc²) - Des tableaux qui restent des tableaux

- Un ordre de lecture correct pour les mises en page complexes

- Des équations conservées (

-

Pipeline "Batteries-Included"

python -m olmocr.pipeline ./workspace --pdfs your_file.pdfÉvoluez de 1 à plus de 100 GPU de manière transparente. La gestion intégrée des erreurs s'attaque aux problèmes courants des PDF, comme la corruption des métadonnées.

-

Open Source, zéro boîte noire Les poids, les données d'entraînement (oui, les 250 000 pages !) et le code sont publics. Basé sur Qwen2-VL-7B-Instruct - aucune dépendance propriétaire.

-

Supériorité prouvée par l'homme

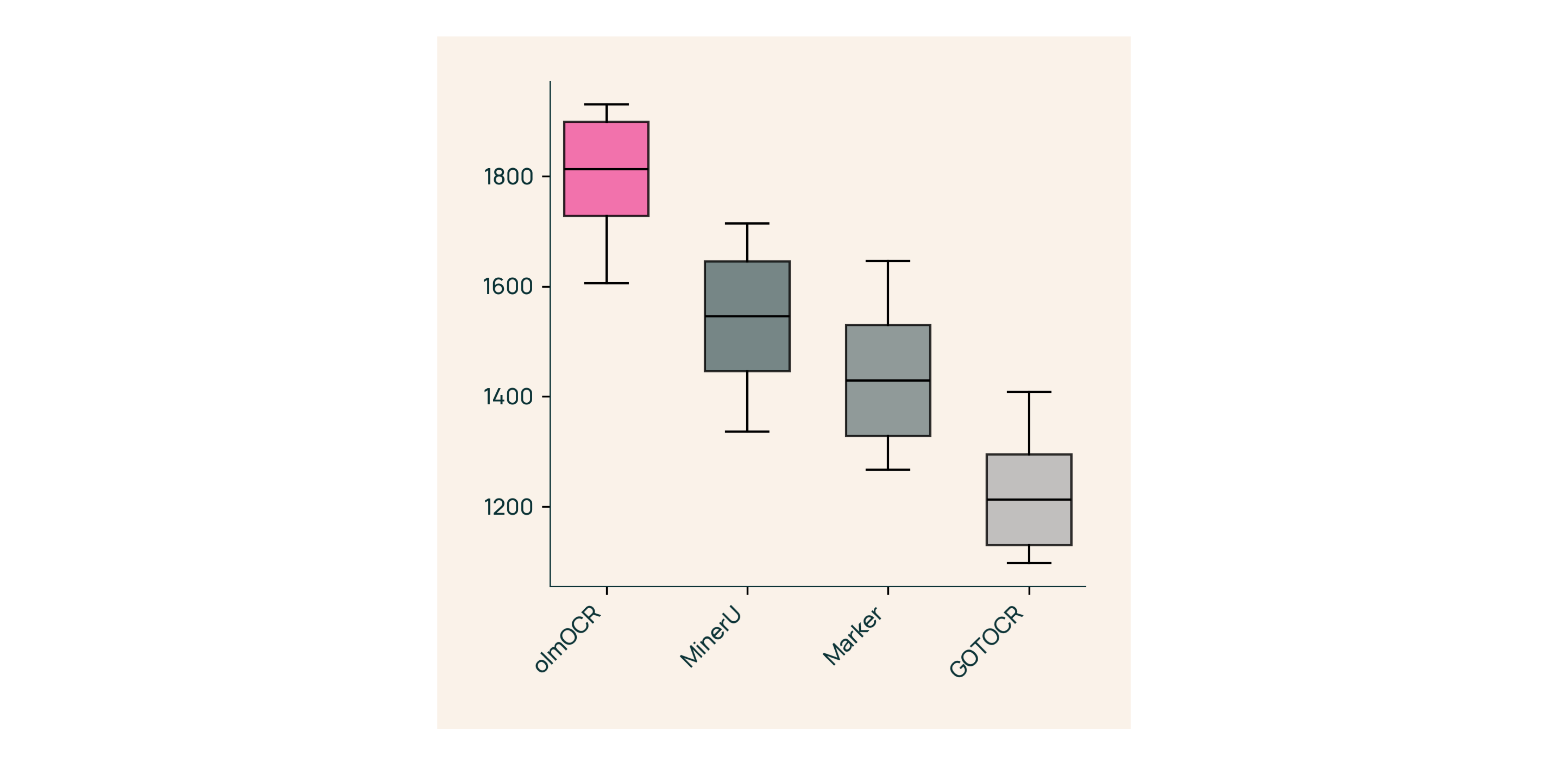

Lors de tests à l'aveugle contre Marker, GOT-OCR 2.0 et MinerU :

Lors de tests à l'aveugle contre Marker, GOT-OCR 2.0 et MinerU :- Gagne 61 % des comparaisons

- Atteint un ELO >1800 (Gold Standard)

Sous le capot : comment nous avons construit olmOCR

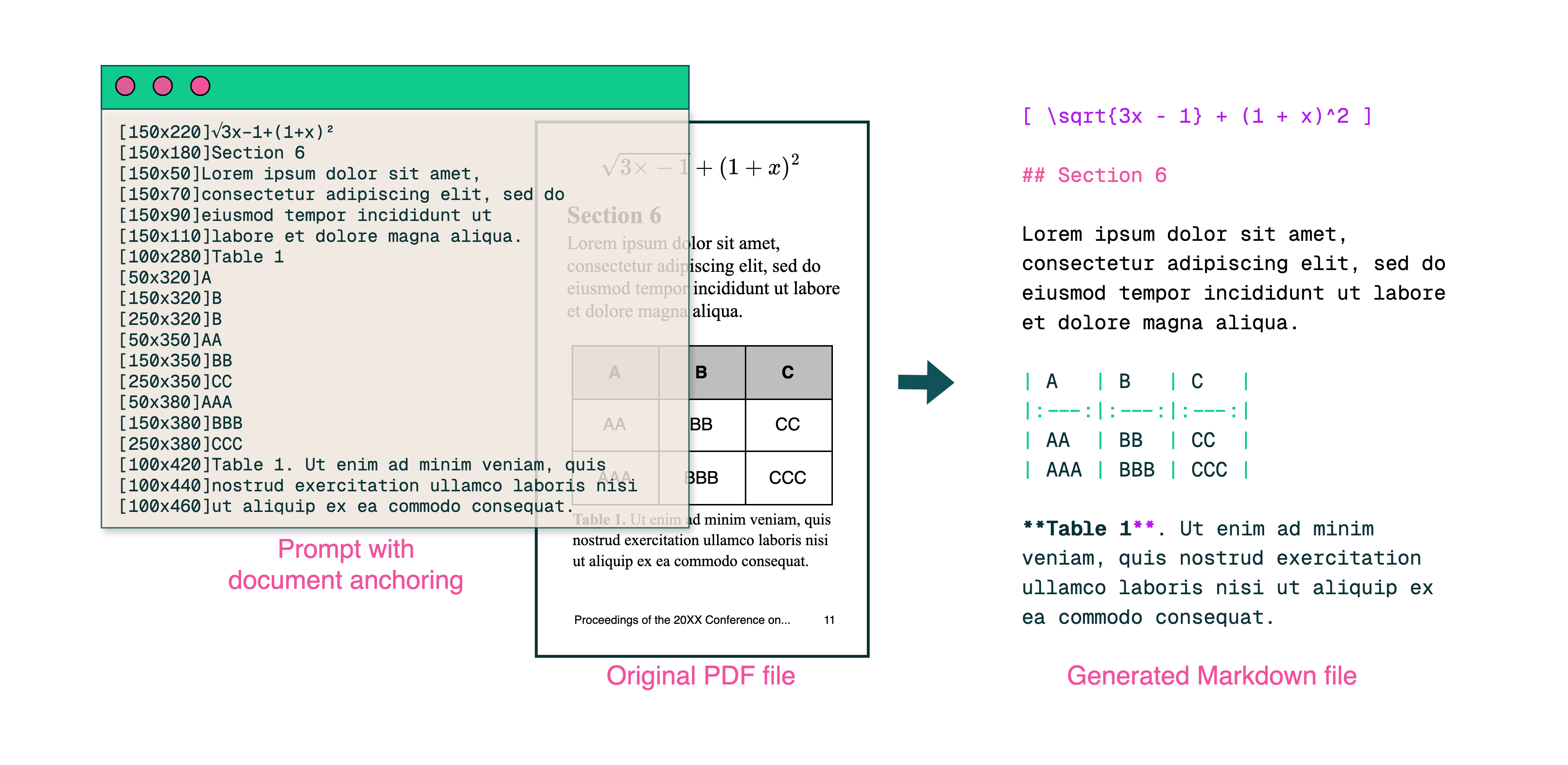

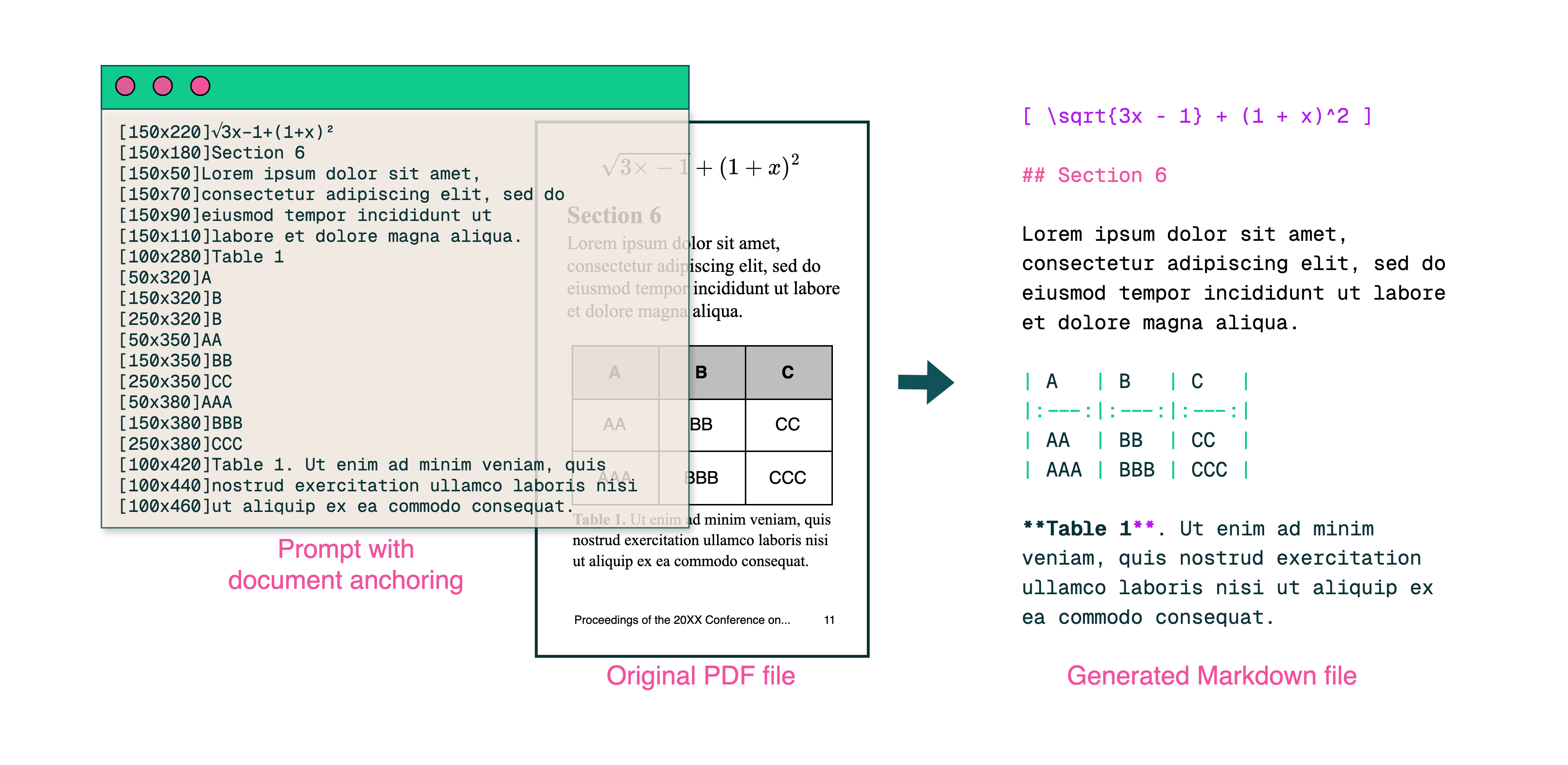

Ancrage de documents : le secret de la réussite

Légende : Contexte texte + image = extraction précise.

Légende : Contexte texte + image = extraction précise.

Nous utilisons le texte/les métadonnées des PDF pour "ancrer" les VLM pendant l'entraînement :

- Extraire les blocs de texte et les régions d'images

- Les combiner dans des invites de modèle

- Laisser GPT-4o générer des étiquettes "gold standard"

Résultat ? Un modèle qui comprend à la fois ce que dit le texte et où il doit se trouver.

Entraînement pour le monde réel

- Ensemble de données : 60 % d'articles universitaires, 12 % de brochures, 11 % de documents juridiques

- Matériel : Optimisé pour les GPU NVIDIA, consommation d'énergie 90 % inférieure à celle des configurations comparables

- Réglage fin : Qwen2-VL-7B-Instruct adapté aux "conversations" de documents

Essayez olmOCR en 3 minutes

- Installer

git clone https://github.com/allenai/olmocr && cd olmocr pip install -e . - Exécuter sur un exemple de PDF

python -m olmocr.pipeline ./demo_output --pdfs tests/gnarly_pdfs/horribleocr.pdf - Vérifier le Markdown

Ouvrez

./demo_output/horribleocr.md- voyez les tableaux, les équations et le flux de texte intacts !

Conclusion

olmOCR n'est pas qu'un simple outil, c'est un changement de paradigme. En associant les VLM à une ingénierie transparente, il rend l'extraction de texte de haute qualité accessible à tous. Que vous construisiez un corpus de recherche ou que vous automatisiez le traitement des factures, cette boîte à outils doit faire partie de votre pile technologique.

Prochaines étapes

- ⭐ Étoilez le dépôt GitHub

- 📊 Comparez les résultats à l'aide de l'outil interactif

- 💬 Rejoignez la discussion sur Hugging Face

Transformons la douleur des PDF en gain de texte brut ! 🚀