Pengekstrakan Teks PDF yang Cekap dengan Model Bahasa Visi —— Mengapa olmOCR Mengubah Permainan

OLMOCR Team

3 Mac 2025

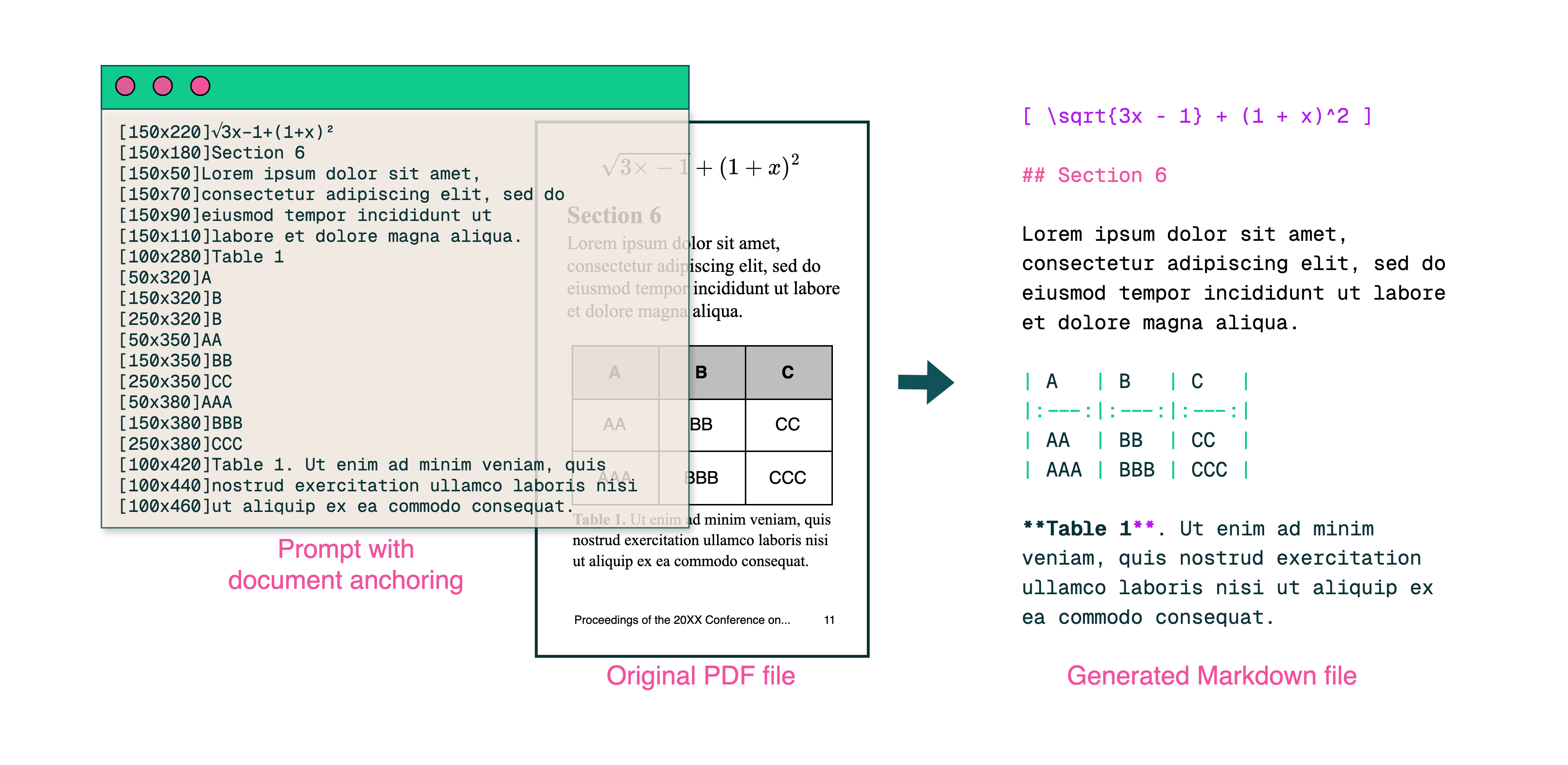

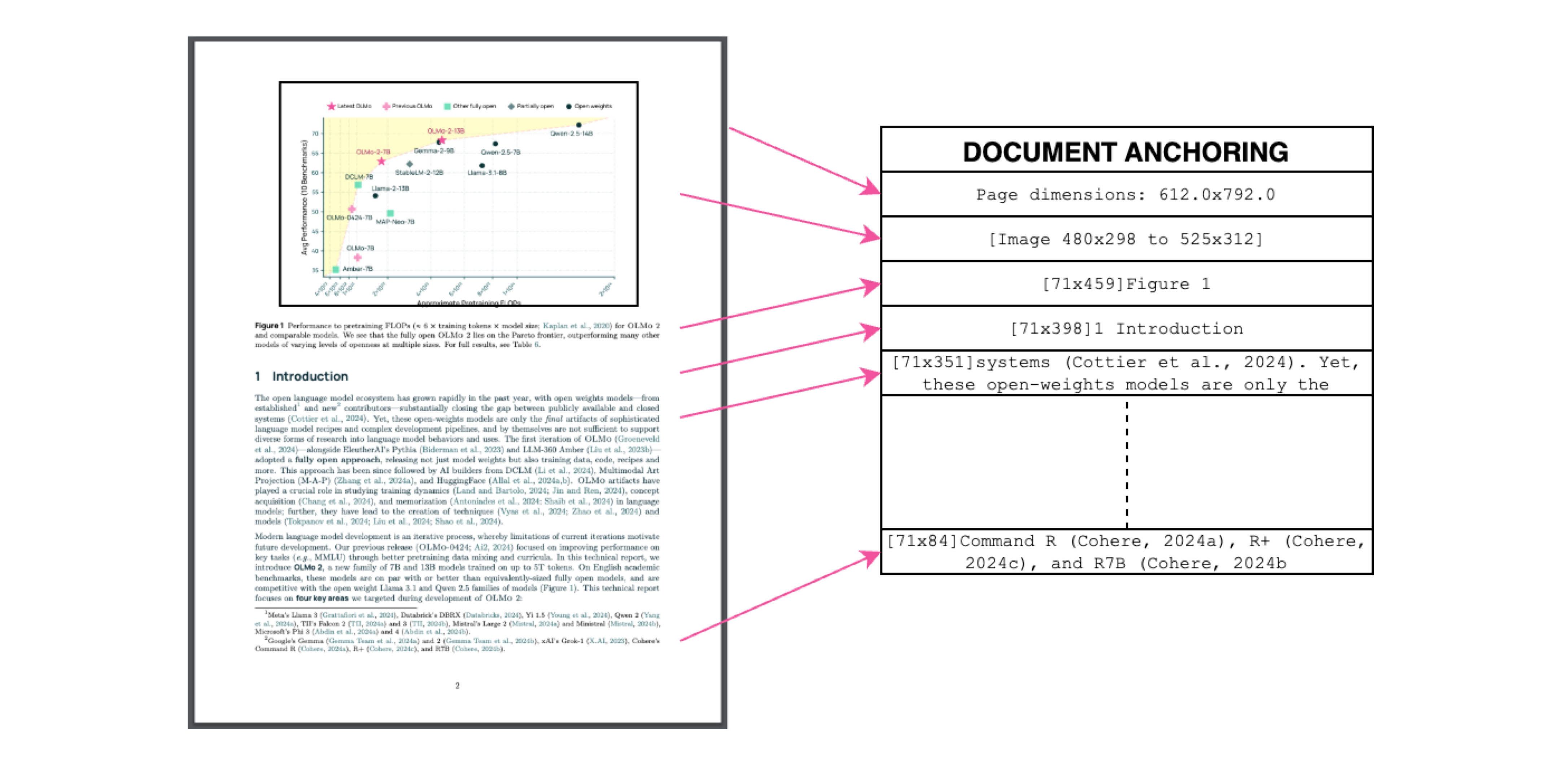

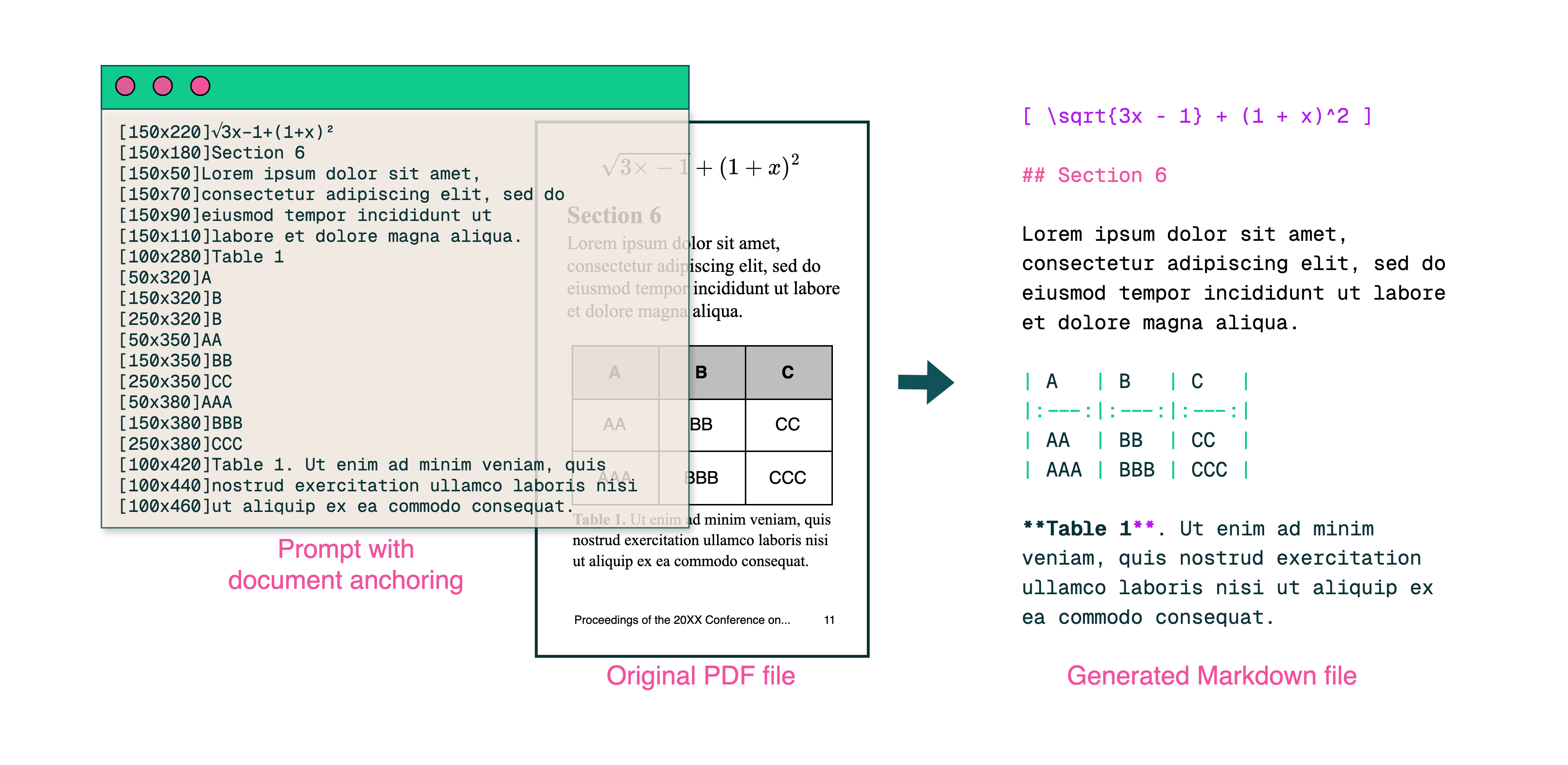

Kapsyen: Rangkaian hujung-ke-hujung olmOCR menukarkan PDF yang berselerak kepada teks Markdown berstruktur pada kos 1/32 daripada GPT-4o.

Kapsyen: Rangkaian hujung-ke-hujung olmOCR menukarkan PDF yang berselerak kepada teks Markdown berstruktur pada kos 1/32 daripada GPT-4o.

Cabaran Tersembunyi PDF: Mengapa Teks Biasa Penting

Model bahasa berkembang pesat dengan teks yang bersih—tetapi PDF adalah musuh ketat. Direka untuk mencetak, bukan mengurai, mereka mengacau kedudukan teks, menanam jadual dalam kod binari, dan menukarkan persamaan menjadi teka-teki visual. Alat OCR tradisional? Mereka sering terlepas format, bergelut dengan susun atur berbilang lajur, atau mengenakan bayaran yang mahal.

Masukkan olmOCR: kit alat sumber terbuka yang menggabungkan model bahasa visi (VLMs) dengan kejuruteraan pintar untuk memecahkan kod PDF. Mari kita huraikan mengapa pembangun dan penyelidik berdebar-debar mengenainya.

5 Sebab olmOCR Mengatasi Alat Lain

-

Kecekapan Kos yang Sukar Diabaikan

Proses 1 juta halaman dengan harga $190—itu 32x lebih murah daripada API kelompok GPT-4o. Bagaimana? Dengan penalaan halus pada 250K halaman yang pelbagai (kertas akademik, dokumen undang-undang, malah surat tulisan tangan) dan mengoptimumkan inferens dengan SGLang/vLLM.

Proses 1 juta halaman dengan harga $190—itu 32x lebih murah daripada API kelompok GPT-4o. Bagaimana? Dengan penalaan halus pada 250K halaman yang pelbagai (kertas akademik, dokumen undang-undang, malah surat tulisan tangan) dan mengoptimumkan inferens dengan SGLang/vLLM. -

Keajaiban Markdown Tiada lagi mimpi ngeri regex. olmOCR mengeluarkan Markdown bersih dengan:

- Persamaan terpelihara (

E=mc²) - Jadual yang kekal sebagai jadual

- Susunan bacaan yang betul untuk susun atur yang kompleks

- Persamaan terpelihara (

-

Rangkaian Bateri-Termasuk

python -m olmocr.pipeline ./workspace --pdfs your_file.pdfSkala daripada 1 kepada 100+ GPU dengan lancar. Pengendalian ralat terbina dalam menangani masalah PDF biasa seperti kerosakan metadata.

-

Sumber Terbuka, Kotak Hitam Sifar Berat, data latihan (ya, semua 250K halaman!), dan kod adalah awam. Dibina pada Qwen2-VL-7B-Instruct—tiada kebergantungan proprietari.

-

Keunggulan Terbukti Manusia

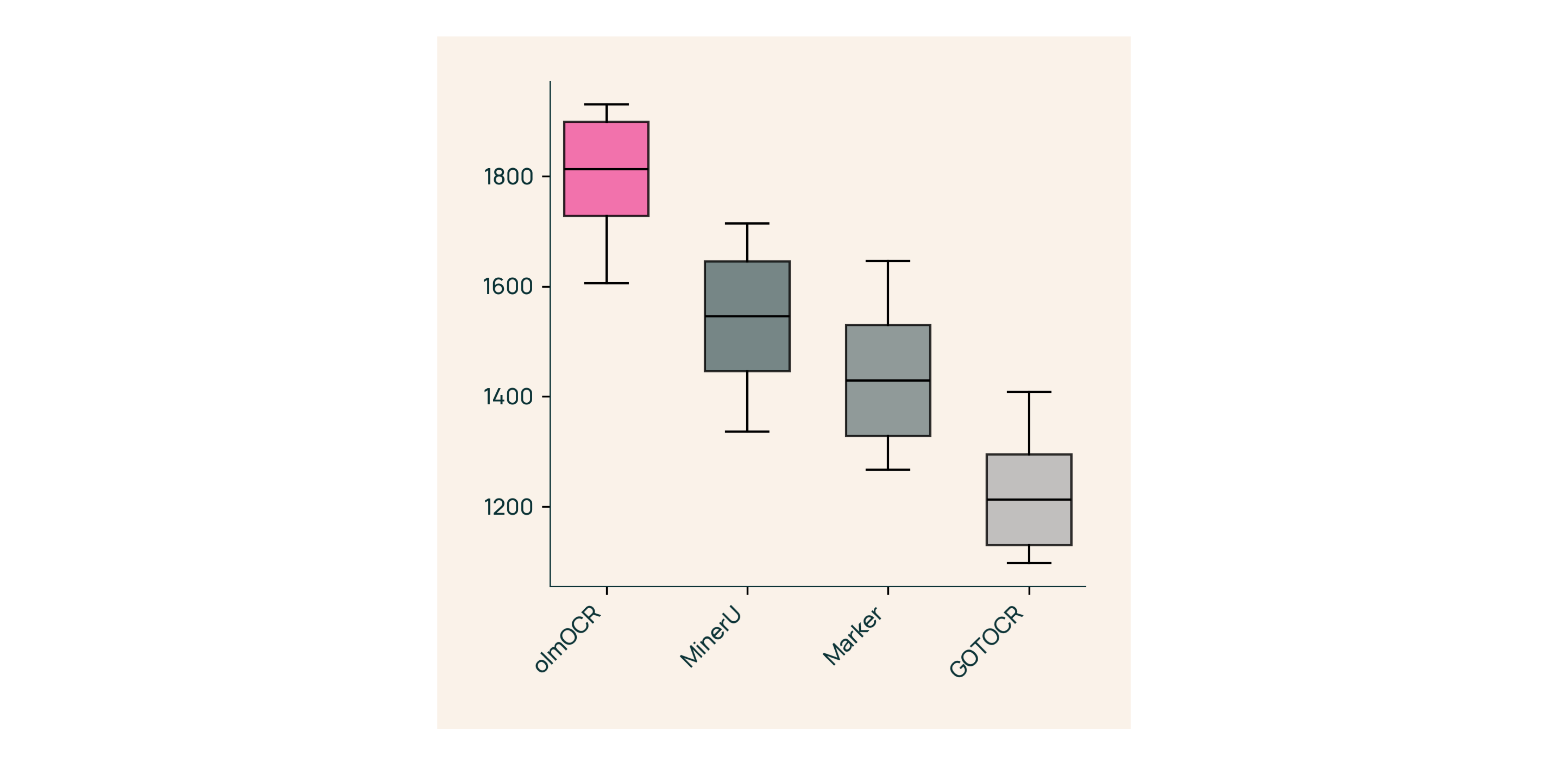

Dalam ujian buta terhadap Marker, GOT-OCR 2.0, dan MinerU:

Dalam ujian buta terhadap Marker, GOT-OCR 2.0, dan MinerU:- Menang 61% daripada perbandingan

- Mencapai ELO >1800 (Piawaian Emas)

Di Bawah Tudung: Bagaimana Kami Membina olmOCR

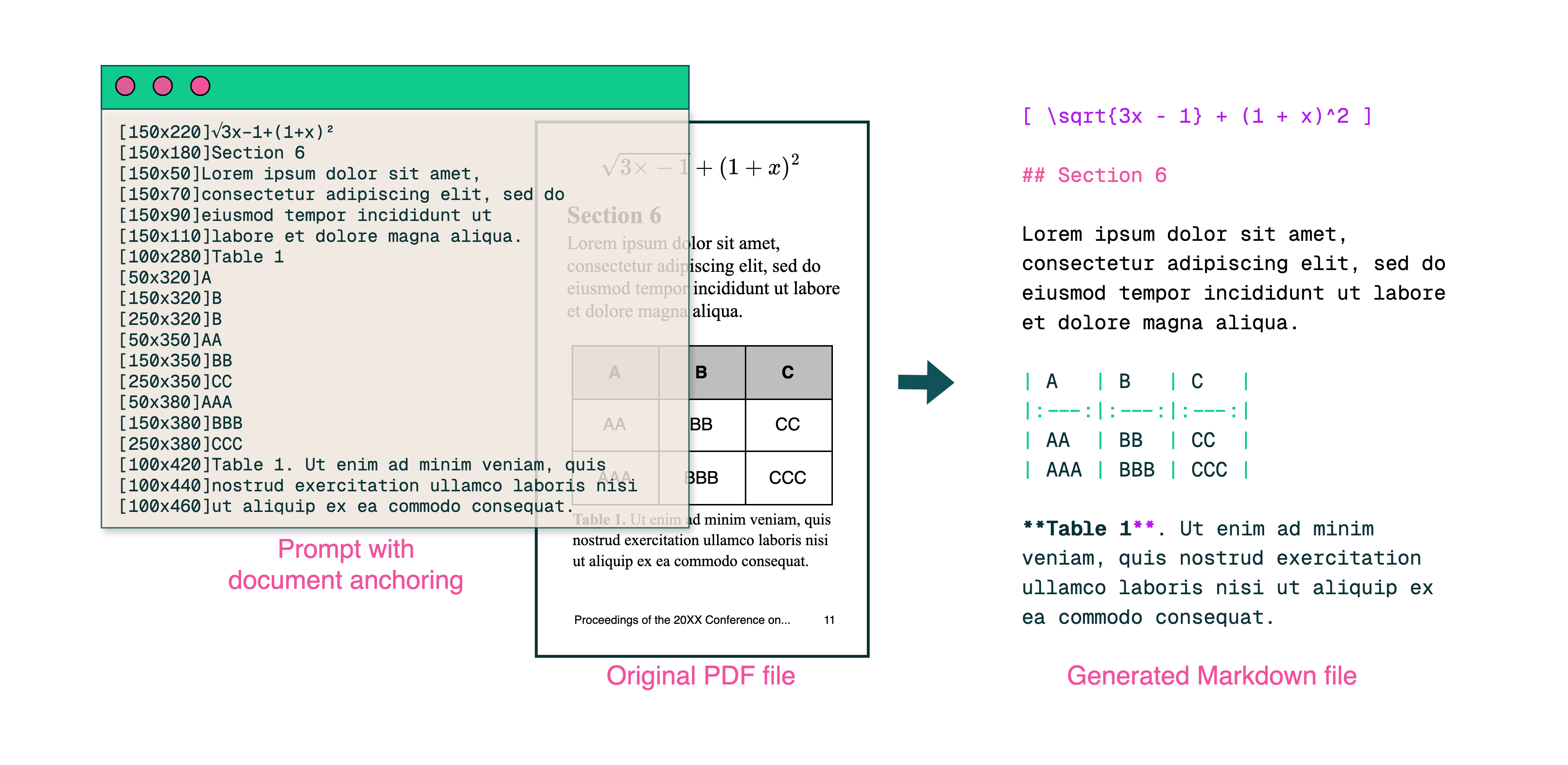

Penjangkaran Dokumen: Sos Rahsia

Kapsyen: Konteks teks + imej = pengekstrakan yang tepat.

Kapsyen: Konteks teks + imej = pengekstrakan yang tepat.

Kami menggunakan teks/metadata PDF sendiri untuk "menjangkar" VLMs semasa latihan:

- Ekstrak blok teks & kawasan imej

- Gabungkannya dalam gesaan model

- Biarkan GPT-4o menjana label "piawaian emas"

Hasilnya? Model yang memahami apa yang dikatakan teks dan di mana ia berada.

Latihan untuk Dunia Sebenar

- Set Data: 60% kertas akademik, 12% brosur, 11% dokumen undang-undang

- Perkakasan: Dioptimumkan untuk GPU NVIDIA, penggunaan tenaga 90% lebih rendah daripada persediaan yang serupa

- Penalaan Halus: Qwen2-VL-7B-Instruct diadaptasi untuk "perbualan" dokumen

Cuba olmOCR dalam 3 Minit

- Pasang

git clone https://github.com/allenai/olmocr && cd olmocr pip install -e . - Jalankan pada PDF Contoh

python -m olmocr.pipeline ./demo_output --pdfs tests/gnarly_pdfs/horribleocr.pdf - Semak Markdown

Buka

./demo_output/horribleocr.md—lihat jadual, persamaan, dan aliran teks utuh!

Kesimpulan Akhir

olmOCR bukan sekadar alat lain—ia adalah perubahan paradigma. Dengan menggabungkan VLMs dengan kejuruteraan yang telus, ia menjadikan pengekstrakan teks berkualiti tinggi boleh diakses oleh semua orang. Sama ada anda membina korpus penyelidikan atau mengautomasikan pemprosesan invois, kit alat ini patut ada dalam timbunan anda.

Langkah Seterusnya

- ⭐ Bintang repositori GitHub

- 📊 Bandingkan output menggunakan Alat Interaktif

- 💬 Sertai perbincangan di Hugging Face

Mari kita ubah kesakitan PDF menjadi keuntungan teks biasa! 🚀