Trích xuất văn bản PDF hiệu quả với Mô hình Ngôn ngữ Thị giác —— Tại sao olmOCR thay đổi cuộc chơi

OLMOCR Team

3 tháng 3, 2025

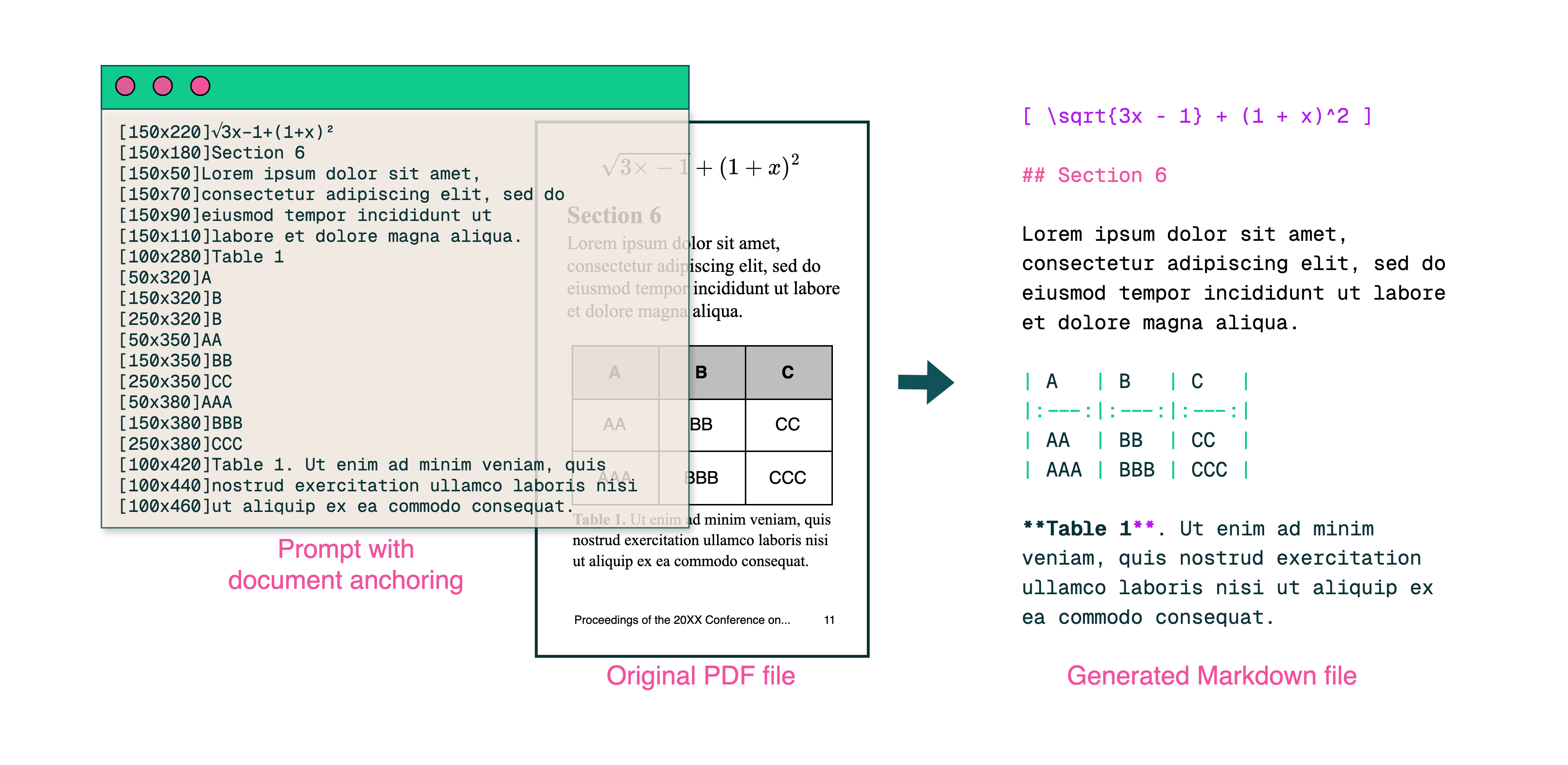

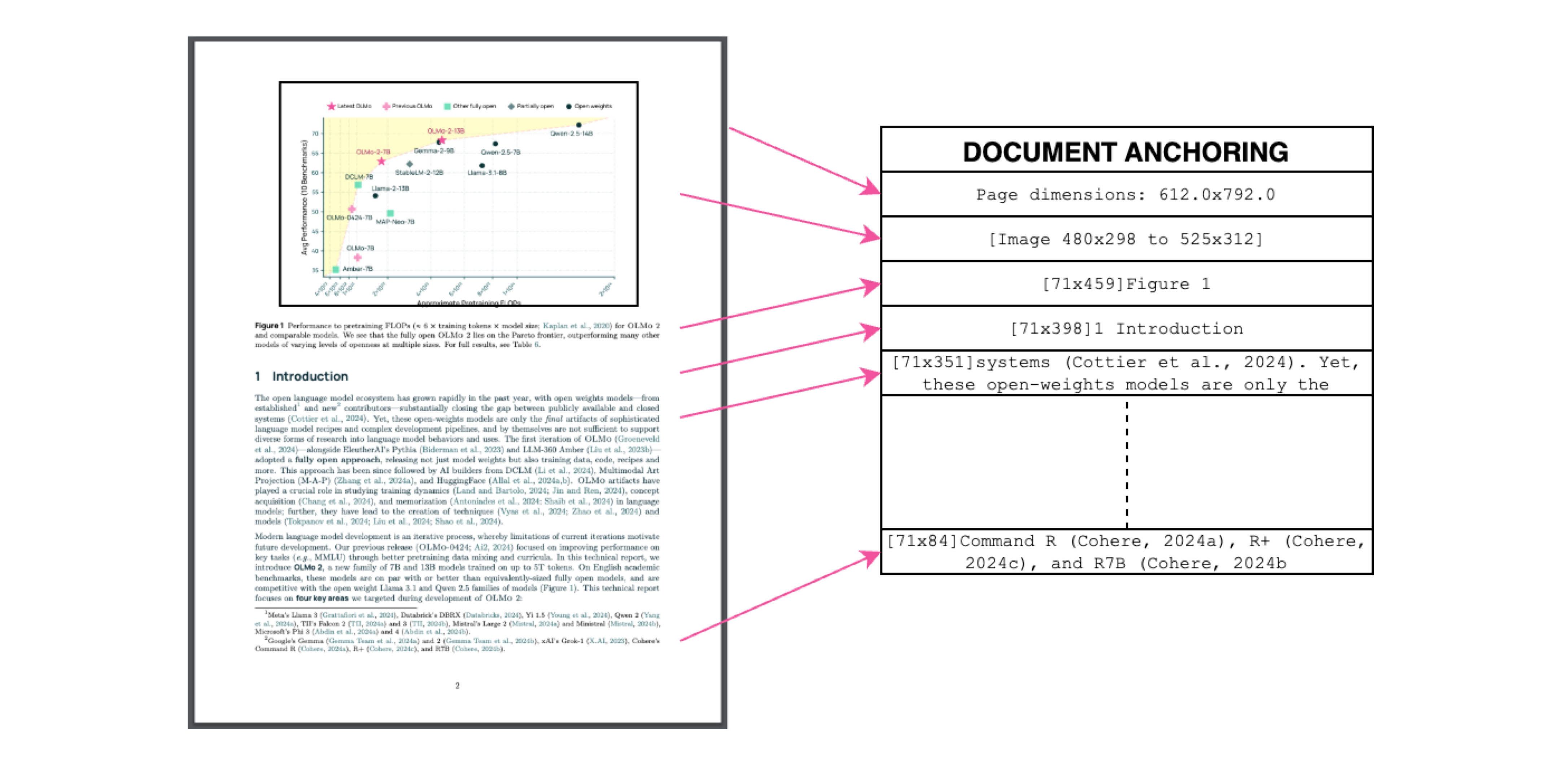

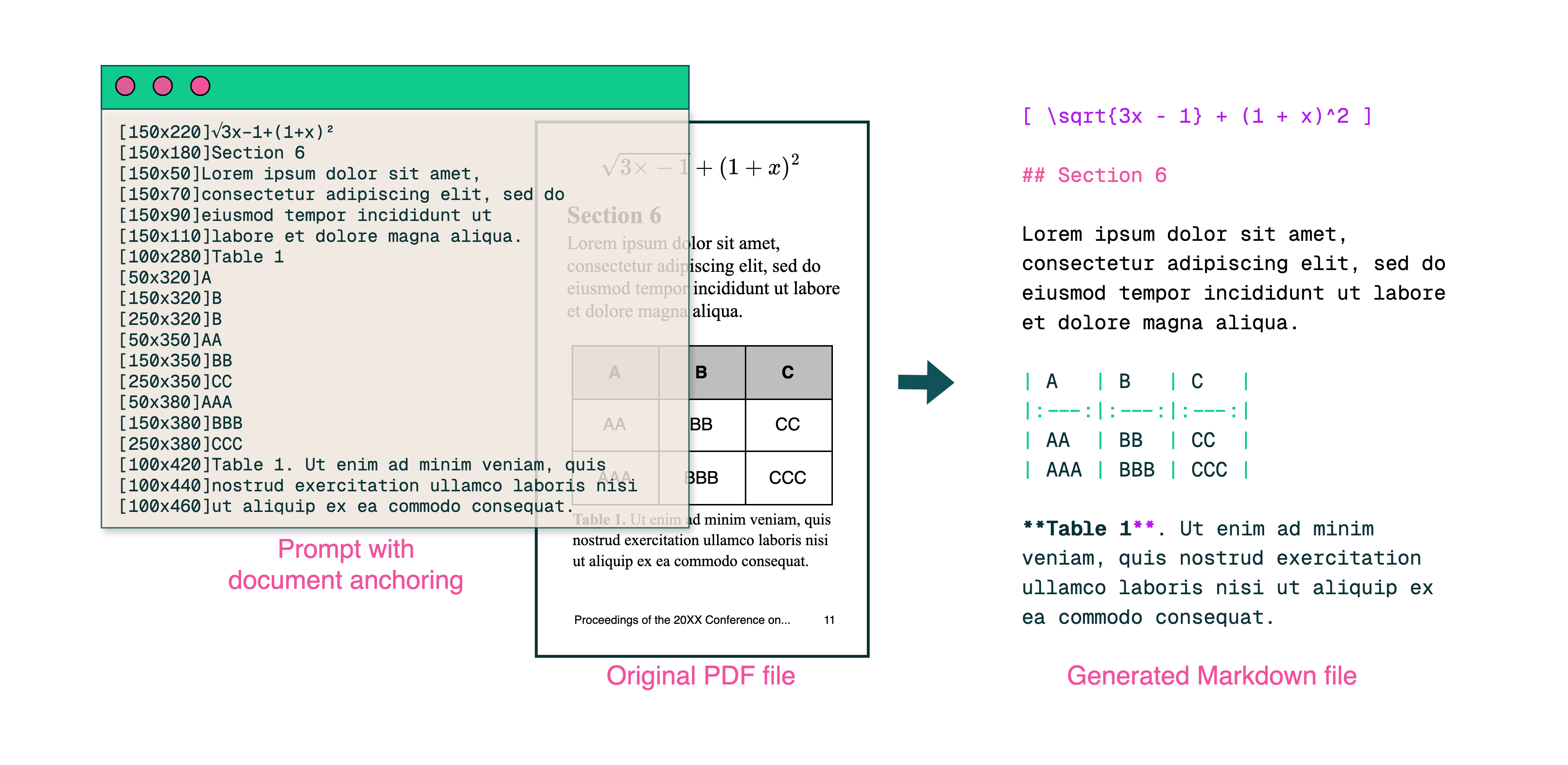

Chú thích: Quy trình đầu cuối của olmOCR chuyển đổi các tệp PDF lộn xộn thành văn bản Markdown có cấu trúc với chi phí chỉ bằng 1/32 so với GPT-4o.

Chú thích: Quy trình đầu cuối của olmOCR chuyển đổi các tệp PDF lộn xộn thành văn bản Markdown có cấu trúc với chi phí chỉ bằng 1/32 so với GPT-4o.

Thách thức ẩn giấu của PDF: Tại sao văn bản thuần túy lại quan trọng

Các mô hình ngôn ngữ phát triển mạnh mẽ với văn bản sạch—nhưng PDF là kẻ thù không đội trời chung. Được thiết kế để in ấn, không phải để phân tích cú pháp, chúng làm rối tung vị trí văn bản, chôn vùi bảng trong mã nhị phân và biến các phương trình thành những câu đố trực quan. Các công cụ OCR truyền thống? Chúng thường bỏ lỡ định dạng, gặp khó khăn với bố cục nhiều cột hoặc tính phí rất cao.

Hãy đến với olmOCR: một bộ công cụ mã nguồn mở kết hợp các mô hình ngôn ngữ thị giác (VLM) với kỹ thuật thông minh để giải mã PDF. Hãy cùng phân tích lý do tại sao các nhà phát triển và nhà nghiên cứu lại xôn xao về nó.

5 lý do olmOCR vượt trội hơn các công cụ khác

-

Hiệu quả chi phí khó có thể bỏ qua

Xử lý 1 triệu trang với giá 190 đô la—rẻ hơn 32 lần so với API hàng loạt của GPT-4o. Làm thế nào? Bằng cách tinh chỉnh trên 250 nghìn trang đa dạng (bài báo học thuật, tài liệu pháp lý, thậm chí cả thư viết tay) và tối ưu hóa suy luận với SGLang/vLLM.

Xử lý 1 triệu trang với giá 190 đô la—rẻ hơn 32 lần so với API hàng loạt của GPT-4o. Làm thế nào? Bằng cách tinh chỉnh trên 250 nghìn trang đa dạng (bài báo học thuật, tài liệu pháp lý, thậm chí cả thư viết tay) và tối ưu hóa suy luận với SGLang/vLLM. -

Ma thuật Markdown Không còn những cơn ác mộng regex. olmOCR xuất ra Markdown sạch với:

- Các phương trình được bảo toàn (

E=mc²) - Bảng vẫn là bảng

- Thứ tự đọc chính xác cho các bố cục phức tạp

- Các phương trình được bảo toàn (

-

Quy trình tích hợp sẵn

python -m olmocr.pipeline ./workspace --pdfs your_file.pdfMở rộng quy mô từ 1 đến hơn 100 GPU một cách liền mạch. Xử lý lỗi tích hợp giải quyết các vấn đề PDF phổ biến như hỏng siêu dữ liệu.

-

Mã nguồn mở, không có hộp đen Trọng số, dữ liệu đào tạo (có, tất cả 250 nghìn trang!) và mã đều công khai. Được xây dựng trên Qwen2-VL-7B-Instruct—không có phụ thuộc độc quyền.

-

Tính ưu việt đã được chứng minh bởi con người

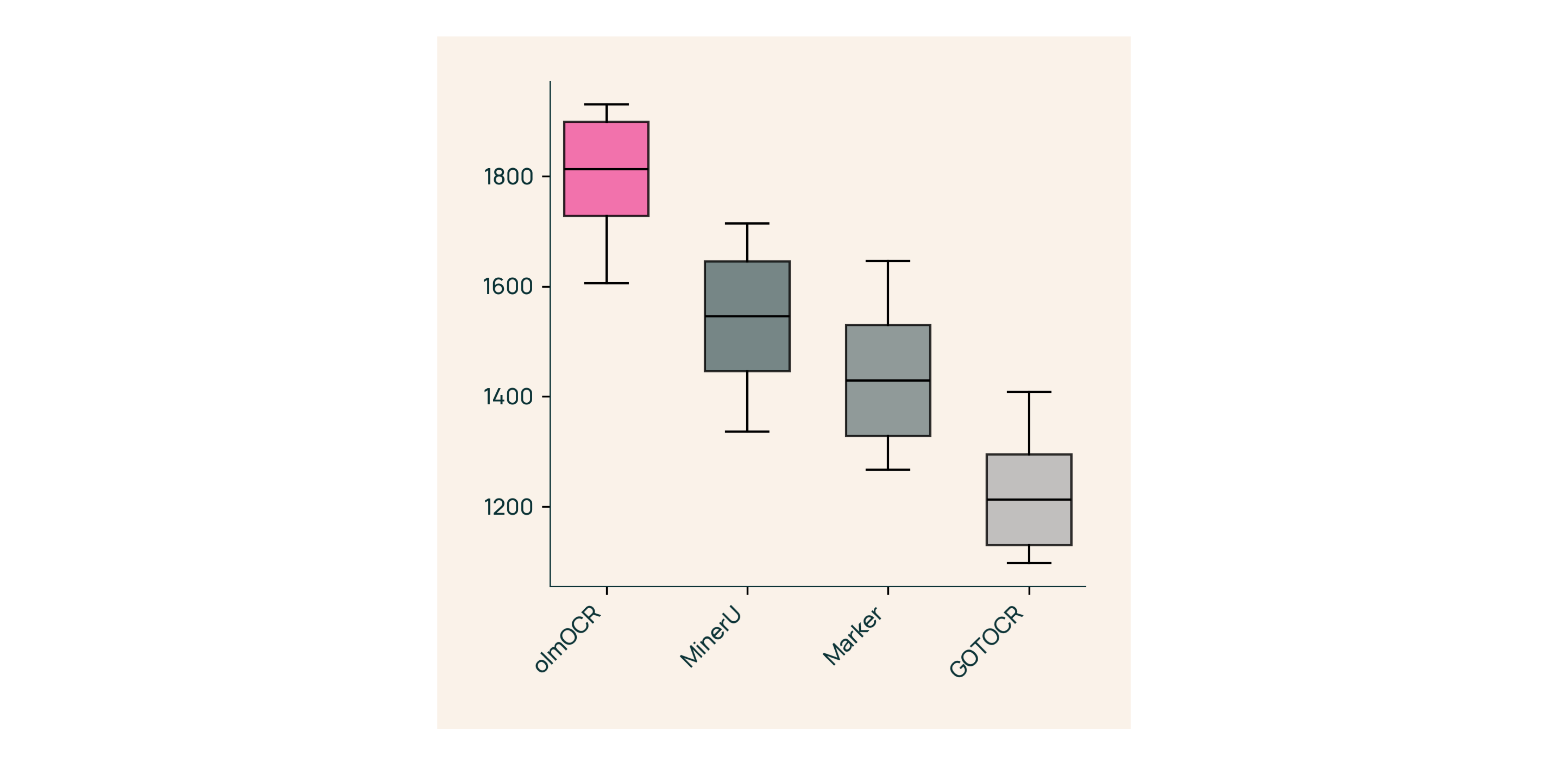

Trong các bài kiểm tra mù so với Marker, GOT-OCR 2.0 và MinerU:

Trong các bài kiểm tra mù so với Marker, GOT-OCR 2.0 và MinerU:- Thắng 61% các so sánh

- Đạt ELO >1800 (Tiêu chuẩn Vàng)

Bên dưới lớp vỏ: Cách chúng tôi xây dựng olmOCR

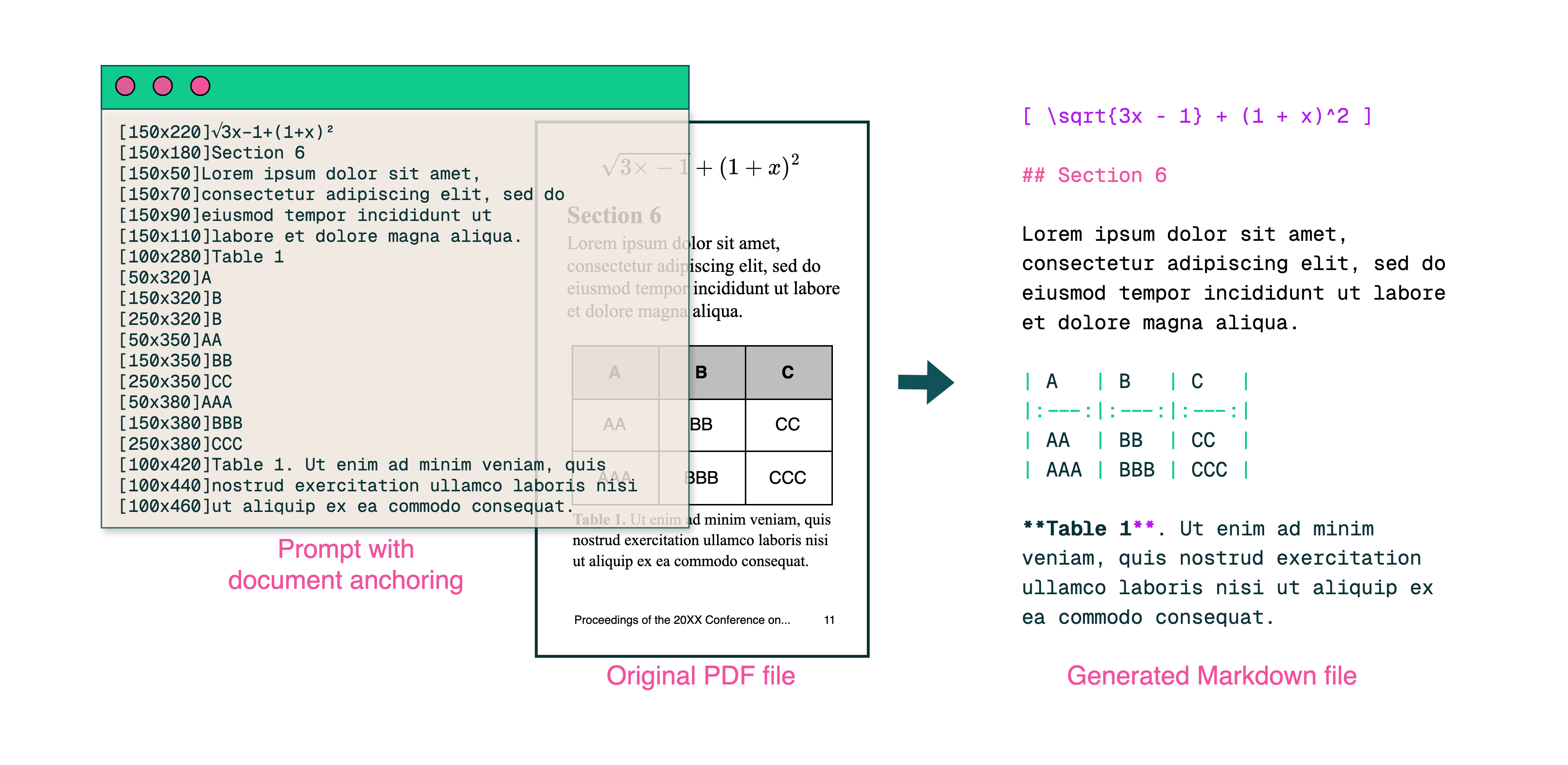

Neo tài liệu: Bí quyết

Chú thích: Ngữ cảnh văn bản + hình ảnh = trích xuất chính xác.

Chú thích: Ngữ cảnh văn bản + hình ảnh = trích xuất chính xác.

Chúng tôi sử dụng văn bản/siêu dữ liệu của PDF để "neo" VLM trong quá trình đào tạo:

- Trích xuất các khối văn bản & vùng hình ảnh

- Kết hợp chúng trong lời nhắc mô hình

- Để GPT-4o tạo ra các nhãn "tiêu chuẩn vàng"

Kết quả? Một mô hình hiểu cả văn bản nói gì và nó thuộc về đâu.

Đào tạo cho thế giới thực

- Tập dữ liệu: 60% bài báo học thuật, 12% tài liệu quảng cáo, 11% tài liệu pháp lý

- Phần cứng: Tối ưu hóa cho GPU NVIDIA, sử dụng năng lượng thấp hơn 90% so với các thiết lập tương đương

- Tinh chỉnh: Qwen2-VL-7B-Instruct được điều chỉnh cho các "cuộc trò chuyện" tài liệu

Dùng thử olmOCR trong 3 phút

- Cài đặt

git clone https://github.com/allenai/olmocr && cd olmocr pip install -e . - Chạy trên PDF mẫu

python -m olmocr.pipeline ./demo_output --pdfs tests/gnarly_pdfs/horribleocr.pdf - Kiểm tra Markdown

Mở

./demo_output/horribleocr.md—xem bảng, phương trình và luồng văn bản còn nguyên vẹn!

Kết luận cuối cùng

olmOCR không chỉ là một công cụ khác—đó là một sự thay đổi mô hình. Bằng cách kết hợp VLM với kỹ thuật minh bạch, nó giúp mọi người có thể truy cập trích xuất văn bản chất lượng cao. Cho dù bạn đang xây dựng một kho lưu trữ nghiên cứu hay tự động hóa việc xử lý hóa đơn, bộ công cụ này nên có trong ngăn xếp của bạn.

Các bước tiếp theo

- ⭐ Đánh dấu kho lưu trữ GitHub

- 📊 So sánh kết quả đầu ra bằng Công cụ tương tác

- 💬 Tham gia thảo luận trên Hugging Face

Hãy biến nỗi đau PDF thành lợi ích văn bản thuần túy! 🚀